Una imagen- aparentemente generada por IA - de una explosión frente al Pentágono en Arlington, Virginia, se hizo viral el lunes por la mañana, aunque el Departamento de Defensa confirmó horas después era falsa. Esto ocurrió en medio de un contexto donde los funcionarios del gobierno continúan advirtiendo sobre los peligros de la desinformación generada por IA.

La imagen, que circuló por páginas de Twitter poco después de las 10 de la mañana del lunes, mostraba una explosión en un césped fuera del Pentágono (el post original ha sido eliminado desde entonces).

Un vocero del Departamento de Defensa confirmó a Forbes que la imagen, que dominó las búsquedas en Google y Twitter, es una “información falsa”, mientras que el Departamento de Bomberos y Servicios Médicos de Emergencia de Arlington tuiteó: "NO hay ninguna explosión ni incidente" ni "peligro o riesgos inmediatos para el público".

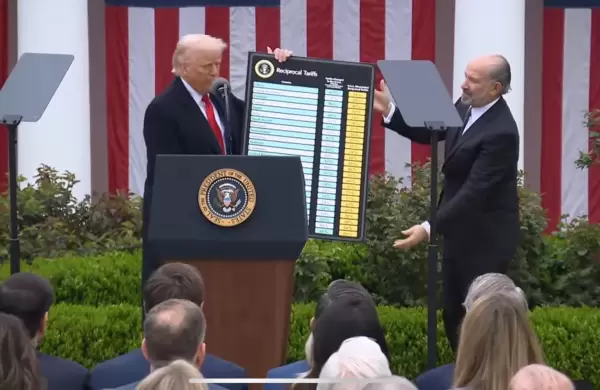

No se ha determinado la fuente de la imagen, aunque se produce en un momento en el que los "deepfakes" generados por IA notablemente realistas lanzan un gran revuelo en Internet, incluyendo una serie sobre el Papa Francisco vistiendo un abrigo de Balenciaga, así como representaciones generadas por IA de obras de arte famosas como "La joven de la perla" de Johannes Vermeer; e imágenes virales realistas del ex presidente Donald Trump resistiéndose a las autoridades durante un falso arresto.

Principal crítico

El auge de la inteligencia artificial ha provocado un amplio abanico de advertencias por parte de funcionarios gubernamentales y de varias grandes empresas estadounidenses, sobre las amenazas de la IA si no se controla.

La Administración Biden desveló a principios de este mes un plan de 140 millones de dólares para crear siete institutos nacionales de investigación que evalúen la tecnología de la IA e impulsen la innovación responsable, señalando los riesgos potenciales de "ciberseguridad, bioseguridad y seguridad" que podría conllevar la tecnología.

Un grupo de líderes del sector, entre los que se encuentran Elon Musk, consejero delegado de Twitter, y Steve Wozniak, cofundador de Apple, también instaron a los laboratorios de IA a frenar su desarrollo, advirtiendo de que se están embarcando en una "carrera descontrolada" para crear una tecnología cada vez más avanzada, mientras que Geoffrey Hinton, apodado el "Padrino de la IA", advirtió de que la tecnología podría ser explotada por "actores malintencionados".

Antecedentes clave

Las deepfakes generadas por IA se han extendido como la pólvora en las redes sociales desde el lanzamiento de una serie de tecnologías de IA muy potentes, entre ellas la impresionante ChatGPT, de OpenAI, con las que tecnologías parecidas a las humanas escribían poesía y ensayos de nivel universitario y engañaban a los investigadores haciéndoles creer que los artículos científicos generados por IA ,eran reales.

Tras el lanzamiento de ChatGPT el pasado mes de noviembre, varios sistemas escolares públicos importantes han prohibido la tecnología por temor a que los estudiantes pudieran utilizarla para hacer trampas en las redacciones y los deberes, mientras que las grandes empresas también han empezado a tomar medidas enérgicas contra su uso por temor a que los empleados pudieran filtrar información interna sensible. (En una revocación de su decisión de la semana pasada, el sistema de escuelas públicas de la ciudad de Nueva York decidió permitir que los estudiantes utilizaran la plataforma).